Default

Door Remote - 15 May 2026

Nu AI-modellen steeds meer gemeengoed worden, racen startups om de softwarelaag te bouwen die erbovenop zit. Een interessante nieuwkomer op dit gebied is Osaurus, een open source LLM-server die alleen voor Apple beschikbaar is en waarmee gebruikers tussen verschillende lokale AI-modellen kunnen schakelen, zowel lokaal als in de cloud, terwijl ze hun bestanden en tools allemaal op hun eigen hardware bewaren.

Osaurus is voortgekomen uit het idee voor een desktop AI-metgezel, Dinoki, die mede-oprichter van Osaurus, Terence Pae, omschreef als een soort ‘AI-aangedreven Clippy’. Dinoki’s klanten hadden hem gevraagd waarom ze de app zouden kopen als ze nog steeds moesten betalen voor tokens – de gebruikseenheden die AI-bedrijven in rekening brengen voor het verwerken van prompts en het genereren van reacties.

Dat zette Pae aan het denken over het lokaal uitvoeren van AI.

“Zo begon Osaurus”, vertelde Pae, voorheen een software-ingenieur bij Tesla en Netflix, tijdens een telefoongesprek aan TechCrunch. Het idee, zo legde hij uit, was om lokaal een AI-assistent te runnen. "Je kunt vrijwel alles lokaal op je Mac doen, zoals door je bestanden bladeren, toegang krijgen tot je browser en toegang krijgen tot je systeemconfiguraties. Ik dacht dat dit een geweldige manier zou zijn om Osaurus te positioneren als een persoonlijke AI voor individuen."

Pae begon de tool publiekelijk te bouwen als een open-sourceproject, waarbij hij gaandeweg functies toevoegde en bugs repareerde.

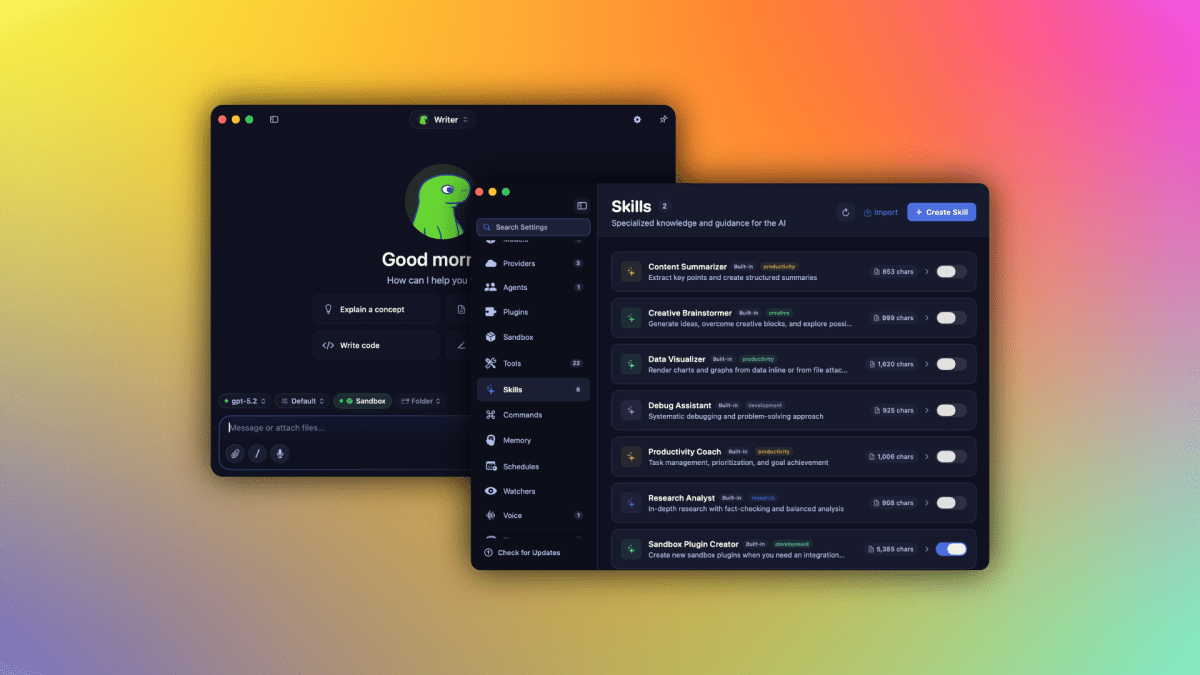

Beeldcredits: Osaurus, Inc.

Tegenwoordig kan Osaurus flexibel verbinding maken met lokaal gehoste AI-modellen of cloudproviders zoals OpenAI en Anthropic. Gebruikers kunnen vrij kiezen welke AI-modellen ze gebruiken en andere aspecten van de AI-ervaring op hun eigen hardware bewaren, zoals het eigen geheugen van de modellen, of hun bestanden en tools.

Gegeven dat verschillende AI-modellen verschillende sterke punten hebben, is het voordeel van dit systeem dat gebruikers kunnen overstappen naar het AI-model dat het beste bij hun behoeften past.

Een dergelijke structuur maakt van Osaurus een zogenaamde ‘harnas’: een controlelaag die verschillende AI-modellen, tools en workflows verbindt via één enkele interface, vergelijkbaar met tools als OpenClaw of Hermes. Het verschil is echter dat dergelijke tools vaak gericht zijn op ontwikkelaars die de weg kennen op een terminal. En soms, zoals in het geval van OpenClaw, kunnen ze beveiligingsproblemen en gaten opleveren waar u zich zorgen over moet maken.

Osaurus presenteert ondertussen een eenvoudig te gebruiken interface die consumenten kunnen gebruiken, en pakt beveiligingsproblemen aan door dingen uit te voeren in een hardware-geïsoleerde, virtuele sandbox. Dit beperkt de AI tot een bepaalde reikwijdte, waardoor uw computer en gegevens veilig blijven.

Beeldcredits: Osaurus, Inc.

Natuurlijk staat de praktijk van het uitvoeren van AI-modellen op uw machine nog in de kinderschoenen, aangezien dit zeer resource-intensief en hardware-afhankelijk is. Om lokale modellen te kunnen gebruiken, heeft uw systeem minimaal 64 GB RAM nodig. Voor het draaien van grotere modellen, zoals DeepSeek v4, raadt Pae systemen aan met ongeveer 128 GB RAM.

Maar Pae gelooft dat de behoeften van lokale AI in de loop van de tijd zullen afnemen.

"Ik zie het potentieel ervan, omdat de intelligentie per wattage – wat vergelijkbaar is met de maatstaf voor lokale AI – aanzienlijk is gestegen. Het bevindt zich op zijn eigen innovatiecurve. Vorig jaar kon lokale AI nauwelijks zinnen afmaken, maar vandaag kan het daadwerkelijk tools uitvoeren, code schrijven, toegang krijgen tot je browser en dingen bestellen bij Amazon [...] het wordt alleen maar beter en beter, "zei hij.

Beeldcredits: Osaurus, Inc.

Osaurus kan tegenwoordig MiniMax M2.5, Gemma 4, Qwen3.6, GPT-OSS, Llama, DeepSeek V4 en andere modellen gebruiken. Het ondersteunt ook de on-device basismodellen van Apple, de LFM-familie van on-device-modellen van Liquid AI, en in de cloud kan het verbinding maken met OpenAI, Anthropic, Gemini, xAI/Grok, Venice AI, OpenRouter, Ollama en LM Studio.

Als volledige MCP-server (Model Context Protocol) kunt u elke MCP-compatibele client ook toegang tot uw tools geven. Bovendien wordt het geleverd met meer dan 20 native plug-ins voor Mail, Agenda, Vision, macOS Use, XLSX, PPTX, Browser, Muziek, Git, Bestandssysteem, Zoeken, Ophalen en meer.

Meer recentelijk is Osaurus bijgewerkt met stemmogelijkheden.

Sinds het project bijna een jaar geleden live ging, is het volgens de website ruim 112.000 keer gedownload.

Momenteel nemen de oprichters van Osaurus (waaronder medeoprichter Sam Yoo) deel aan de in New York gevestigde startup accelerator Alliance. Ze denken ook na over volgende stappen, waarbij Osaurus zou kunnen worden aangeboden aan bedrijven, zoals bedrijven in de juridische ruimte of in de gezondheidszorg, waar het runnen van lokale LLM's privacyproblemen zou kunnen aanpakken.

Naarmate de kracht van lokale AI-modellen groeit, denkt het team dat dit de vraag naar AI-datacenters kan verminderen.

"We zien deze explosieve groei in de AI-ruimte waar [cloud AI-aanbieders] moeten opschalen met behulp van datacenters en infrastructuur, maar we hebben het gevoel dat mensen de waarde van de lokale AI nog niet echt hebben gezien", zei Pae. "In plaats van te vertrouwen op de cloud, kunnen ze feitelijk een Mac Studio op locatie inzetten, en die zou aanzienlijk minder stroom moeten gebruiken. Je hebt nog steeds de mogelijkheden van de cloud, maar je bent niet afhankelijk van een datacenter om die AI te kunnen draaien", voegde hij eraan toe.

Osaurus is voortgekomen uit het idee voor een desktop AI-metgezel, Dinoki, die mede-oprichter van Osaurus, Terence Pae, omschreef als een soort ‘AI-aangedreven Clippy’. Dinoki’s klanten hadden hem gevraagd waarom ze de app zouden kopen als ze nog steeds moesten betalen voor tokens – de gebruikseenheden die AI-bedrijven in rekening brengen voor het verwerken van prompts en het genereren van reacties.

Dat zette Pae aan het denken over het lokaal uitvoeren van AI.

“Zo begon Osaurus”, vertelde Pae, voorheen een software-ingenieur bij Tesla en Netflix, tijdens een telefoongesprek aan TechCrunch. Het idee, zo legde hij uit, was om lokaal een AI-assistent te runnen. "Je kunt vrijwel alles lokaal op je Mac doen, zoals door je bestanden bladeren, toegang krijgen tot je browser en toegang krijgen tot je systeemconfiguraties. Ik dacht dat dit een geweldige manier zou zijn om Osaurus te positioneren als een persoonlijke AI voor individuen."

Pae begon de tool publiekelijk te bouwen als een open-sourceproject, waarbij hij gaandeweg functies toevoegde en bugs repareerde.

Beeldcredits: Osaurus, Inc.

Tegenwoordig kan Osaurus flexibel verbinding maken met lokaal gehoste AI-modellen of cloudproviders zoals OpenAI en Anthropic. Gebruikers kunnen vrij kiezen welke AI-modellen ze gebruiken en andere aspecten van de AI-ervaring op hun eigen hardware bewaren, zoals het eigen geheugen van de modellen, of hun bestanden en tools.

Gegeven dat verschillende AI-modellen verschillende sterke punten hebben, is het voordeel van dit systeem dat gebruikers kunnen overstappen naar het AI-model dat het beste bij hun behoeften past.

Een dergelijke structuur maakt van Osaurus een zogenaamde ‘harnas’: een controlelaag die verschillende AI-modellen, tools en workflows verbindt via één enkele interface, vergelijkbaar met tools als OpenClaw of Hermes. Het verschil is echter dat dergelijke tools vaak gericht zijn op ontwikkelaars die de weg kennen op een terminal. En soms, zoals in het geval van OpenClaw, kunnen ze beveiligingsproblemen en gaten opleveren waar u zich zorgen over moet maken.

Osaurus presenteert ondertussen een eenvoudig te gebruiken interface die consumenten kunnen gebruiken, en pakt beveiligingsproblemen aan door dingen uit te voeren in een hardware-geïsoleerde, virtuele sandbox. Dit beperkt de AI tot een bepaalde reikwijdte, waardoor uw computer en gegevens veilig blijven.

Beeldcredits: Osaurus, Inc.

Natuurlijk staat de praktijk van het uitvoeren van AI-modellen op uw machine nog in de kinderschoenen, aangezien dit zeer resource-intensief en hardware-afhankelijk is. Om lokale modellen te kunnen gebruiken, heeft uw systeem minimaal 64 GB RAM nodig. Voor het draaien van grotere modellen, zoals DeepSeek v4, raadt Pae systemen aan met ongeveer 128 GB RAM.

Maar Pae gelooft dat de behoeften van lokale AI in de loop van de tijd zullen afnemen.

"Ik zie het potentieel ervan, omdat de intelligentie per wattage – wat vergelijkbaar is met de maatstaf voor lokale AI – aanzienlijk is gestegen. Het bevindt zich op zijn eigen innovatiecurve. Vorig jaar kon lokale AI nauwelijks zinnen afmaken, maar vandaag kan het daadwerkelijk tools uitvoeren, code schrijven, toegang krijgen tot je browser en dingen bestellen bij Amazon [...] het wordt alleen maar beter en beter, "zei hij.

Beeldcredits: Osaurus, Inc.

Osaurus kan tegenwoordig MiniMax M2.5, Gemma 4, Qwen3.6, GPT-OSS, Llama, DeepSeek V4 en andere modellen gebruiken. Het ondersteunt ook de on-device basismodellen van Apple, de LFM-familie van on-device-modellen van Liquid AI, en in de cloud kan het verbinding maken met OpenAI, Anthropic, Gemini, xAI/Grok, Venice AI, OpenRouter, Ollama en LM Studio.

Als volledige MCP-server (Model Context Protocol) kunt u elke MCP-compatibele client ook toegang tot uw tools geven. Bovendien wordt het geleverd met meer dan 20 native plug-ins voor Mail, Agenda, Vision, macOS Use, XLSX, PPTX, Browser, Muziek, Git, Bestandssysteem, Zoeken, Ophalen en meer.

Meer recentelijk is Osaurus bijgewerkt met stemmogelijkheden.

Sinds het project bijna een jaar geleden live ging, is het volgens de website ruim 112.000 keer gedownload.

Momenteel nemen de oprichters van Osaurus (waaronder medeoprichter Sam Yoo) deel aan de in New York gevestigde startup accelerator Alliance. Ze denken ook na over volgende stappen, waarbij Osaurus zou kunnen worden aangeboden aan bedrijven, zoals bedrijven in de juridische ruimte of in de gezondheidszorg, waar het runnen van lokale LLM's privacyproblemen zou kunnen aanpakken.

Naarmate de kracht van lokale AI-modellen groeit, denkt het team dat dit de vraag naar AI-datacenters kan verminderen.

"We zien deze explosieve groei in de AI-ruimte waar [cloud AI-aanbieders] moeten opschalen met behulp van datacenters en infrastructuur, maar we hebben het gevoel dat mensen de waarde van de lokale AI nog niet echt hebben gezien", zei Pae. "In plaats van te vertrouwen op de cloud, kunnen ze feitelijk een Mac Studio op locatie inzetten, en die zou aanzienlijk minder stroom moeten gebruiken. Je hebt nog steeds de mogelijkheden van de cloud, maar je bent niet afhankelijk van een datacenter om die AI te kunnen draaien", voegde hij eraan toe.