Default

Door Remote - 16 Apr 2026

Physical Intelligence, de twee jaar oude, in San Francisco gevestigde robotica-startup die stilletjes een van de best in de gaten gehouden AI-bedrijven in de Bay Area is geworden, publiceerde donderdag nieuw onderzoek waaruit bleek dat het nieuwste model robots taken kan laten uitvoeren waarvoor ze nooit expliciet zijn getraind – een vermogen dat volgens de eigen onderzoekers van het bedrijf hen overrompelde.

Het nieuwe model, π0.7 genaamd, vertegenwoordigt wat het bedrijf beschrijft als een vroege maar betekenisvolle stap in de richting van het lang gezochte doel van een robotbrein voor algemeen gebruik: een brein dat op een onbekende taak kan worden gericht, er in duidelijke taal doorheen kan worden gecoacht en het ook daadwerkelijk kan uitvoeren. Als de bevindingen de toetsing doorstaan, suggereren ze dat robot-AI mogelijk een keerpunt nadert dat vergelijkbaar is met wat het veld zag met grote taalmodellen – waar capaciteiten zich beginnen te vermenigvuldigen op manieren die sneller gaan dan wat de onderliggende gegevens lijken te voorspellen.

Maar eerst: de kernclaim in het artikel is compositorische generalisatie: het vermogen om vaardigheden die in verschillende contexten zijn geleerd te combineren om problemen op te lossen die het model nog nooit is tegengekomen. Tot nu toe bestond de standaardbenadering van robottraining hoofdzakelijk uit het uit het hoofd leren: verzamel gegevens over een specifieke taak, train een gespecialiseerd model op basis van die gegevens en herhaal dit voor elke nieuwe taak. π0.7, zegt Physical Intelligence, doorbreekt dat patroon.

"Zodra het die drempel overschrijdt waar het gaat van alleen precies datgene doen waarvoor je de gegevens verzamelt, tot het daadwerkelijk remixen van dingen op nieuwe manieren", zegt Sergey Levine, mede-oprichter van Physical Intelligence en een hoogleraar aan de UC Berkeley die zich richt op AI voor robotica, "gaan de mogelijkheden meer dan lineair omhoog met de hoeveelheid gegevens. Die veel gunstigere schaaleigenschap hebben we in andere domeinen gezien, zoals taal en visie."

De meest opvallende demonstratie van de krant betreft een airfryer die het model in wezen nog nooit in training had gezien. Toen het onderzoeksteam dit onderzocht, vonden ze slechts twee relevante episoden in de gehele trainingsdataset: één waarin een andere robot de airfryer alleen maar dichtduwde, en één uit een open source dataset waarin weer een andere robot op bevel van iemand een plastic fles in de airfryer plaatste. Het model had die fragmenten, plus bredere webgebaseerde voortrainingsgegevens, op de een of andere manier gesynthetiseerd tot een functioneel begrip van hoe het apparaat werkt.

“Het is erg moeilijk om te achterhalen waar de kennis vandaan komt, of waar deze zal slagen of mislukken”, zegt Lucy Shi, onderzoeker op het gebied van fysische intelligentie en Ph.D. informatica aan Stanford. student. Toch deed het model, zonder enige begeleiding, een redelijke poging om het apparaat te gebruiken om een zoete aardappel te koken. Met stapsgewijze mondelinge instructies (in wezen een mens die de robot door de taak leidt zoals je iets aan een nieuwe medewerker zou kunnen uitleggen) verliep het met succes.

Dat coachingvermogen is van belang omdat het suggereert dat robots in nieuwe omgevingen kunnen worden ingezet en in realtime kunnen worden verbeterd zonder aanvullende gegevensverzameling of herscholing van modellen.

Dus wat betekent het allemaal? De onderzoekers zijn niet verlegen over de beperkingen van het model en zorgen ervoor dat ze niet op de zaken vooruitlopen. In minstens één geval wijzen ze regelrecht met de vinger naar hun eigen team.

“Soms ligt de foutmodus niet op de robot of op het model”, zegt Shi. "Het ligt aan ons. We zijn niet goed in snelle engineering." Ze beschrijft een experiment met een vroege airfryer dat een succespercentage van 5% opleverde. Nadat ze ongeveer een half uur had besteed aan het verfijnen van de manier waarop de taak aan het model werd uitgelegd, steeg dit naar 95%, zegt ze.

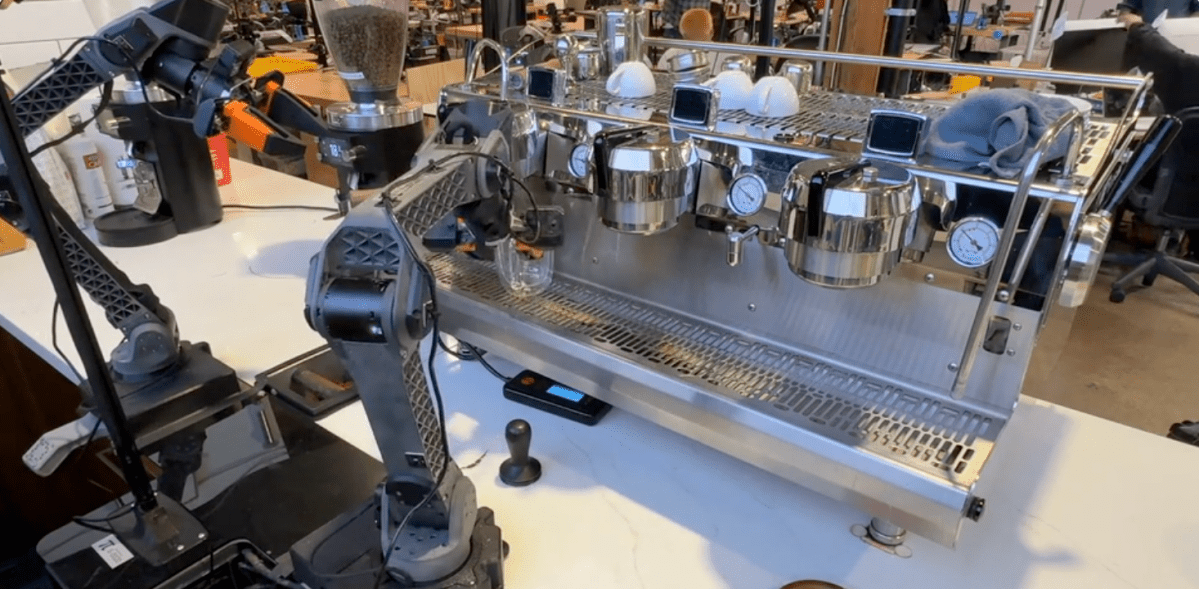

Beeldcredits: fysieke intelligentie

Het model is ook nog niet in staat om complexe, uit meerdere stappen bestaande taken autonoom uit te voeren vanuit één enkel commando op hoog niveau. "Je kunt het niet zeggen: 'Hé, ga wat toast voor me maken'", zegt Levine. "Maar als je het doorneemt - 'voor de broodrooster, open dit onderdeel, druk op die knop, doe dit' - dan werkt het eigenlijk best goed."

Het team erkende ook dat gestandaardiseerde benchmarks voor robotica niet echt bestaan, wat externe validatie van hun beweringen moeilijk maakt. In plaats daarvan heeft het bedrijf π0,7 vergeleken met zijn eigen eerdere specialistische modellen – speciaal gebouwde systemen die zijn getraind op individuele taken – en ontdekte dat het generalistische model hun prestaties evenaarde bij een reeks complexe werkzaamheden, waaronder koffie zetten, wasgoed opvouwen en dozen in elkaar zetten.

Wat misschien wel het meest opvalt aan het onderzoek – als je de onderzoekers op hun woord gelooft – is niet één enkele demo, maar de mate waarin de resultaten hen verrasten, mensen wier taak het is om precies te weten wat er in de trainingsgegevens staat en dus wat het model wel en niet zou moeten kunnen.

“Mijn ervaring is altijd geweest dat als ik goed weet wat er in de gegevens zit, ik ongeveer kan raden wat het model kan doen”, zegt Ashwin Balakrishna, wetenschappelijk onderzoeker bij Physical Intelligence. "Ik ben zelden verrast. Maar de afgelopen maanden was ik voor het eerst echt verrast. Ik kocht gewoon willekeurig een tandwielset en vroeg aan de robot: 'Hé, kun je dit tandwiel draaien?' En het werkte gewoon."

Levine herinnerde zich het moment waarop onderzoekers GPT-2 voor het eerst tegenkwamen en een verhaal over eenhoorns in de Andes voortbrachten. "Waar heeft het in vredesnaam over eenhoorns geleerd in Peru?" zegt hij. "Dat is zo'n rare combinatie. En ik denk dat het heel bijzonder is om dat in de robotica te zien."

Uiteraard zullen critici hier op een ongemakkelijke asymmetrie wijzen: taalmodellen hadden het hele internet om van te leren. Robots doen dat niet, en geen enkele slimme aansporing kan die kloof volledig dichten. Maar op de vraag waar hij het scepticisme verwacht, wijst Levine heel ergens anders.

“De kritiek die altijd geuit kan worden op elke demonstratie van robotgeneralisatie is dat de taken nogal saai zijn”, zegt hij. “De robot doet geen achterwaartse salto.” Hij komt op dat kader terug en stelt dat het onderscheid tussen een indrukwekkende robotdemonstratie en een robotsysteem dat daadwerkelijk generaliseert precies het punt is. Generalisatie, zo suggereert hij, zal er altijd minder dramatisch uitzien dan een zorgvuldig gechoreografeerde stunt, maar het is aanzienlijk nuttiger.

Het artikel zelf gebruikt overal zorgvuldige hedging-taal, waarbij π0.7 wordt beschreven als ‘vroege tekenen’ van generalisatie en ‘eerste demonstraties’ van nieuwe mogelijkheden. Dit zijn onderzoeksresultaten, geen ingezet product.

Op de directe vraag wanneer een systeem gebaseerd op deze bevindingen klaar zou kunnen zijn voor implementatie in de echte wereld, weigert Levine te speculeren. “Ik denk dat er goede redenen zijn om optimistisch te zijn, en het gaat zeker sneller vooruit dan ik een paar jaar geleden had verwacht”, zegt hij. “Maar het is voor mij heel moeilijk om die vraag te beantwoorden.”

Fysieke Intelligentie heeft tot nu toe ruim $1 miljard opgehaald en werd recentelijk gewaardeerd op $5,6 miljard. Een aanzienlijk deel van het enthousiasme van investeerders rond het bedrijf is terug te voeren op Lachy Groom, een mede-oprichter die jarenlang een van de meest gewaardeerde engelinvesteerders van Silicon Valley was – onder meer achter Figma, Notion en Ramp – voordat hij besloot dat Physical Intelligence het bedrijf was waarnaar hij op zoek was. Die achtergrond heeft de startup geholpen serieus institutioneel geld aan te trekken, ook al heeft het geweigerd investeerders een commercialiseringstijdlijn te bieden.

Het bedrijf zou nu in gesprek zijn over een nieuwe ronde die het waarderingscijfer bijna zou verdubbelen tot 11 miljard dollar. Het team weigerde commentaar te geven.

Het nieuwe model, π0.7 genaamd, vertegenwoordigt wat het bedrijf beschrijft als een vroege maar betekenisvolle stap in de richting van het lang gezochte doel van een robotbrein voor algemeen gebruik: een brein dat op een onbekende taak kan worden gericht, er in duidelijke taal doorheen kan worden gecoacht en het ook daadwerkelijk kan uitvoeren. Als de bevindingen de toetsing doorstaan, suggereren ze dat robot-AI mogelijk een keerpunt nadert dat vergelijkbaar is met wat het veld zag met grote taalmodellen – waar capaciteiten zich beginnen te vermenigvuldigen op manieren die sneller gaan dan wat de onderliggende gegevens lijken te voorspellen.

Maar eerst: de kernclaim in het artikel is compositorische generalisatie: het vermogen om vaardigheden die in verschillende contexten zijn geleerd te combineren om problemen op te lossen die het model nog nooit is tegengekomen. Tot nu toe bestond de standaardbenadering van robottraining hoofdzakelijk uit het uit het hoofd leren: verzamel gegevens over een specifieke taak, train een gespecialiseerd model op basis van die gegevens en herhaal dit voor elke nieuwe taak. π0.7, zegt Physical Intelligence, doorbreekt dat patroon.

"Zodra het die drempel overschrijdt waar het gaat van alleen precies datgene doen waarvoor je de gegevens verzamelt, tot het daadwerkelijk remixen van dingen op nieuwe manieren", zegt Sergey Levine, mede-oprichter van Physical Intelligence en een hoogleraar aan de UC Berkeley die zich richt op AI voor robotica, "gaan de mogelijkheden meer dan lineair omhoog met de hoeveelheid gegevens. Die veel gunstigere schaaleigenschap hebben we in andere domeinen gezien, zoals taal en visie."

De meest opvallende demonstratie van de krant betreft een airfryer die het model in wezen nog nooit in training had gezien. Toen het onderzoeksteam dit onderzocht, vonden ze slechts twee relevante episoden in de gehele trainingsdataset: één waarin een andere robot de airfryer alleen maar dichtduwde, en één uit een open source dataset waarin weer een andere robot op bevel van iemand een plastic fles in de airfryer plaatste. Het model had die fragmenten, plus bredere webgebaseerde voortrainingsgegevens, op de een of andere manier gesynthetiseerd tot een functioneel begrip van hoe het apparaat werkt.

“Het is erg moeilijk om te achterhalen waar de kennis vandaan komt, of waar deze zal slagen of mislukken”, zegt Lucy Shi, onderzoeker op het gebied van fysische intelligentie en Ph.D. informatica aan Stanford. student. Toch deed het model, zonder enige begeleiding, een redelijke poging om het apparaat te gebruiken om een zoete aardappel te koken. Met stapsgewijze mondelinge instructies (in wezen een mens die de robot door de taak leidt zoals je iets aan een nieuwe medewerker zou kunnen uitleggen) verliep het met succes.

Dat coachingvermogen is van belang omdat het suggereert dat robots in nieuwe omgevingen kunnen worden ingezet en in realtime kunnen worden verbeterd zonder aanvullende gegevensverzameling of herscholing van modellen.

Dus wat betekent het allemaal? De onderzoekers zijn niet verlegen over de beperkingen van het model en zorgen ervoor dat ze niet op de zaken vooruitlopen. In minstens één geval wijzen ze regelrecht met de vinger naar hun eigen team.

“Soms ligt de foutmodus niet op de robot of op het model”, zegt Shi. "Het ligt aan ons. We zijn niet goed in snelle engineering." Ze beschrijft een experiment met een vroege airfryer dat een succespercentage van 5% opleverde. Nadat ze ongeveer een half uur had besteed aan het verfijnen van de manier waarop de taak aan het model werd uitgelegd, steeg dit naar 95%, zegt ze.

Beeldcredits: fysieke intelligentie

Het model is ook nog niet in staat om complexe, uit meerdere stappen bestaande taken autonoom uit te voeren vanuit één enkel commando op hoog niveau. "Je kunt het niet zeggen: 'Hé, ga wat toast voor me maken'", zegt Levine. "Maar als je het doorneemt - 'voor de broodrooster, open dit onderdeel, druk op die knop, doe dit' - dan werkt het eigenlijk best goed."

Het team erkende ook dat gestandaardiseerde benchmarks voor robotica niet echt bestaan, wat externe validatie van hun beweringen moeilijk maakt. In plaats daarvan heeft het bedrijf π0,7 vergeleken met zijn eigen eerdere specialistische modellen – speciaal gebouwde systemen die zijn getraind op individuele taken – en ontdekte dat het generalistische model hun prestaties evenaarde bij een reeks complexe werkzaamheden, waaronder koffie zetten, wasgoed opvouwen en dozen in elkaar zetten.

Wat misschien wel het meest opvalt aan het onderzoek – als je de onderzoekers op hun woord gelooft – is niet één enkele demo, maar de mate waarin de resultaten hen verrasten, mensen wier taak het is om precies te weten wat er in de trainingsgegevens staat en dus wat het model wel en niet zou moeten kunnen.

“Mijn ervaring is altijd geweest dat als ik goed weet wat er in de gegevens zit, ik ongeveer kan raden wat het model kan doen”, zegt Ashwin Balakrishna, wetenschappelijk onderzoeker bij Physical Intelligence. "Ik ben zelden verrast. Maar de afgelopen maanden was ik voor het eerst echt verrast. Ik kocht gewoon willekeurig een tandwielset en vroeg aan de robot: 'Hé, kun je dit tandwiel draaien?' En het werkte gewoon."

Levine herinnerde zich het moment waarop onderzoekers GPT-2 voor het eerst tegenkwamen en een verhaal over eenhoorns in de Andes voortbrachten. "Waar heeft het in vredesnaam over eenhoorns geleerd in Peru?" zegt hij. "Dat is zo'n rare combinatie. En ik denk dat het heel bijzonder is om dat in de robotica te zien."

Uiteraard zullen critici hier op een ongemakkelijke asymmetrie wijzen: taalmodellen hadden het hele internet om van te leren. Robots doen dat niet, en geen enkele slimme aansporing kan die kloof volledig dichten. Maar op de vraag waar hij het scepticisme verwacht, wijst Levine heel ergens anders.

“De kritiek die altijd geuit kan worden op elke demonstratie van robotgeneralisatie is dat de taken nogal saai zijn”, zegt hij. “De robot doet geen achterwaartse salto.” Hij komt op dat kader terug en stelt dat het onderscheid tussen een indrukwekkende robotdemonstratie en een robotsysteem dat daadwerkelijk generaliseert precies het punt is. Generalisatie, zo suggereert hij, zal er altijd minder dramatisch uitzien dan een zorgvuldig gechoreografeerde stunt, maar het is aanzienlijk nuttiger.

Het artikel zelf gebruikt overal zorgvuldige hedging-taal, waarbij π0.7 wordt beschreven als ‘vroege tekenen’ van generalisatie en ‘eerste demonstraties’ van nieuwe mogelijkheden. Dit zijn onderzoeksresultaten, geen ingezet product.

Op de directe vraag wanneer een systeem gebaseerd op deze bevindingen klaar zou kunnen zijn voor implementatie in de echte wereld, weigert Levine te speculeren. “Ik denk dat er goede redenen zijn om optimistisch te zijn, en het gaat zeker sneller vooruit dan ik een paar jaar geleden had verwacht”, zegt hij. “Maar het is voor mij heel moeilijk om die vraag te beantwoorden.”

Fysieke Intelligentie heeft tot nu toe ruim $1 miljard opgehaald en werd recentelijk gewaardeerd op $5,6 miljard. Een aanzienlijk deel van het enthousiasme van investeerders rond het bedrijf is terug te voeren op Lachy Groom, een mede-oprichter die jarenlang een van de meest gewaardeerde engelinvesteerders van Silicon Valley was – onder meer achter Figma, Notion en Ramp – voordat hij besloot dat Physical Intelligence het bedrijf was waarnaar hij op zoek was. Die achtergrond heeft de startup geholpen serieus institutioneel geld aan te trekken, ook al heeft het geweigerd investeerders een commercialiseringstijdlijn te bieden.

Het bedrijf zou nu in gesprek zijn over een nieuwe ronde die het waarderingscijfer bijna zou verdubbelen tot 11 miljard dollar. Het team weigerde commentaar te geven.